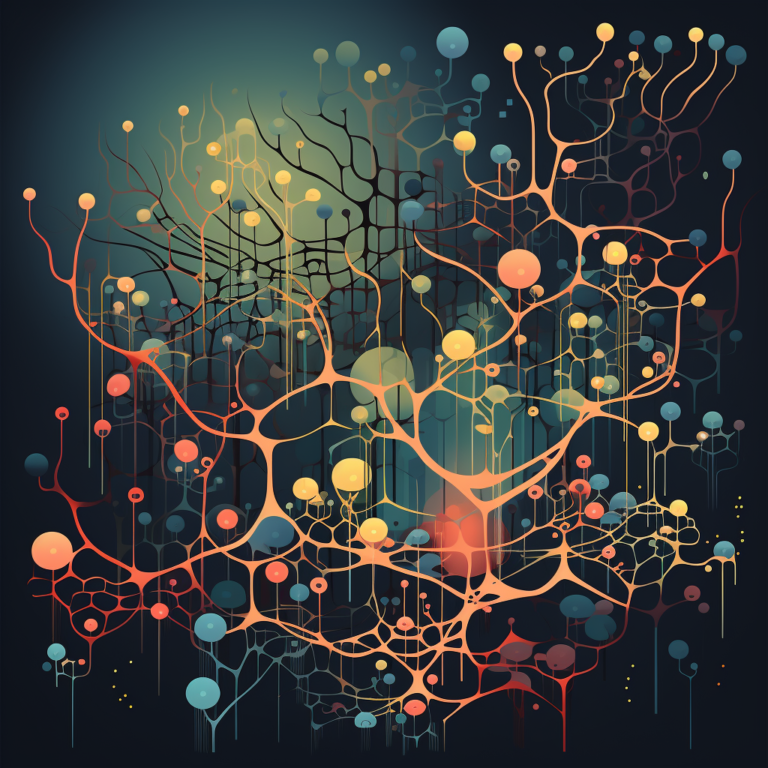

Les transformers : le modèle derrière GPT-3, BERT et T5

Les transformers ont été développés en 2017 par des chercheurs de Google et de l'Université de Toronto, initialement conçus pour faire de la traduction. Mais contrairement aux réseaux de neurones récurrents, les transformers pourraient être parallélisés très efficacement. Et cela signifiait qu'avec le bon matériel, vous pourriez entraîner de très gros modèles.