Introduction

L’intelligence artificielle (IA) a connu des avancées spectaculaires au cours des dernières décennies, mais la quête d’une intelligence artificielle générale (AGI) reste un défi majeur. Contrairement aux IA spécialisées qui dominent aujourd’hui le marché, l’AGI se veut être une intelligence capable de comprendre, apprendre et raisonner d’une manière proche de l’esprit humain, sans nécessiter de supervision humaine explicite. Dans cette perspective, Yann LeCun, l’un des pionniers de l’IA moderne, propose un nouveau modèle d’apprentissage autonome appelé Joint Embedding Predictive Architecture (JEPA). Ce système, conçu pour s’affranchir des limitations des méthodes actuelles d’apprentissage supervisé (non, les LLM actuels tels que ChatGPT ne parviendront jamais à l’AGI, contrairement à ce que les CEO de ses entreprises affirment), offre une approche novatrice pour l’AGI. Cet article explore les fondements de JEPA, ses implications pour l’IA et les perspectives qu’il offre pour l’AGI.

1. Les Limites des Modèles d’Apprentissage Actuels

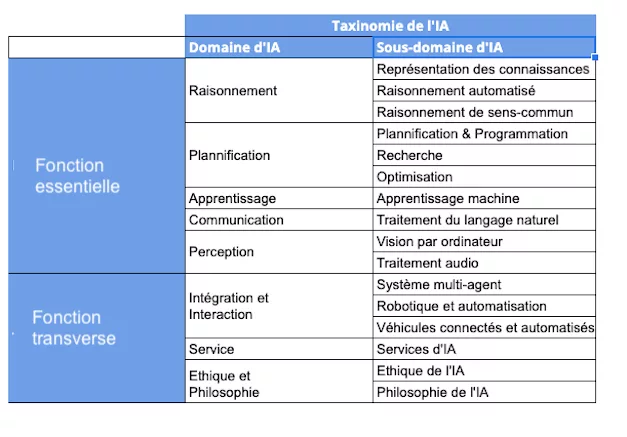

Avant de plonger dans le concept de JEPA, il est essentiel de comprendre les défis inhérents aux approches actuelles de l’apprentissage machine, notamment l’apprentissage supervisé et par renforcement. Dans ces paradigmes, les modèles sont dépendants de vastes quantités de données annotées par des humains. Bien que cette méthode ait permis d’atteindre des performances impressionnantes dans des tâches spécifiques (comme la vision par ordinateur et le traitement du langage naturel), elle reste inadéquate pour le développement d’une AGI.

De plus, l’apprentissage par renforcement, bien que prometteur pour des environnements contrôlés, souffre également de limitations importantes lorsqu’il est confronté à des situations imprévues. L’objectif de JEPA est précisément de dépasser ces limitations, en proposant une forme d’apprentissage plus proche de l’intuition humaine, qui permettrait aux IA d’inférer des connaissances à partir de l’observation et d’agir en autonomie.

Pour se rendre compte de la complexité « d’unir » plusieurs modèles, il faudrait une machine qui soit capable de lier plusieurs sous-domaines d’IA sans erreur.

2. Comprendre le Système JEPA

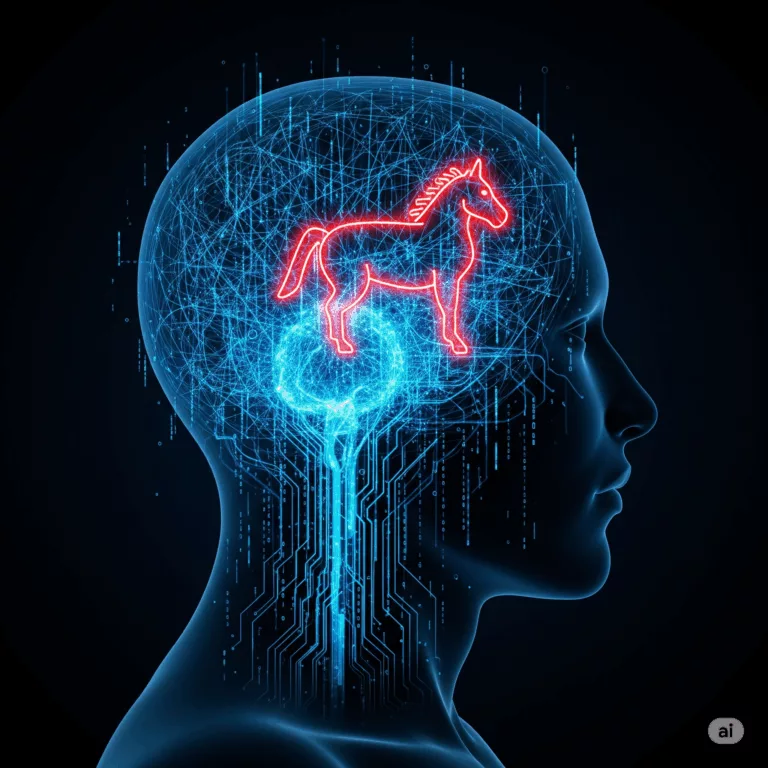

Le Joint Embedding Predictive Architecture (JEPA) est fondé sur un principe central : permettre à une IA de construire une représentation de son environnement en minimisant la prédiction explicite. Autrement dit, JEPA s’éloigne de l’approche consistant à prédire chaque étape suivante pour se concentrer sur une compréhension de haut niveau, ce qui permet de créer une représentation latente de la réalité qui ne dépend pas uniquement de données explicitement annotées.

JEPA fonctionne par l’optimisation conjointe de plusieurs « espaces d’embedding », c’est-à-dire des représentations compressées d’informations que le système peut utiliser pour raisonner. Cette approche favorise l’émergence de modèles de compréhension autonomes, puisque l’IA est encouragée à apprendre à interpréter les données de manière flexible et contextuelle.

3. Les Avantages de JEPA pour l’Apprentissage Autonome

En se concentrant sur la construction de représentations générales plutôt que sur la prédiction minutieuse de chaque donnée, JEPA propose une architecture qui est :

- Généraliste : le modèle est moins dépendant des étiquettes et peut apprendre dans des environnements diversifiés sans supervision intensive.

- Scalable : en réduisant la nécessité de grandes quantités de données étiquetées, JEPA permet une utilisation plus large et économique des ressources.

- Robuste aux changements contextuels : contrairement à l’apprentissage supervisé traditionnel, JEPA est plus flexible et peut s’adapter à des environnements changeants en temps réel.

Ces caractéristiques en font un modèle potentiellement révolutionnaire pour le développement de systèmes AGI, puisqu’il permet de simuler des formes d’apprentissage humain, notamment la capacité d’inférer des concepts abstraits et de généraliser les connaissances.

4. Comparaison avec les Modèles Auto-Régressifs et de Renforcement

Les architectures JEPA se distinguent des modèles auto-régressifs, tels que GPT et d’autres grands modèles de langage, qui fonctionnent en prédisant séquentiellement les données. Là où les modèles auto-régressifs sont limités par leur besoin de données linéaires, JEPA exploite des embeddings joints qui permettent une vision plus holistique de l’environnement.

Quant à l’apprentissage par renforcement, bien qu’il soit performant dans des environnements simulés comme les jeux vidéo, il devient difficile à implémenter pour des situations du monde réel qui nécessitent une compréhension nuancée et abstraite. JEPA pourrait potentiellement contourner ce problème en apprenant des représentations qui ne se limitent pas à des scénarios strictement définis, et qui tolèrent mieux l’incertitude.

5. Les Défis et Limites de l’Approche JEPA

Si JEPA propose une vision prometteuse, plusieurs défis techniques et théoriques demeurent. Par exemple :

- La gestion des biais dans les embeddings : Bien que JEPA réduise la nécessité d’annotations humaines, il est encore susceptible d’hériter de biais présents dans les données d’origine.

- La complexité computationnelle : La création d’espaces d’embedding conjoints implique des ressources de calcul importantes, ce qui peut limiter l’application de JEPA à des systèmes moins puissants.

- La validation empirique : Puisqu’il s’agit d’une approche émergente, les études empiriques de JEPA dans des environnements diversifiés et imprévisibles restent limitées.

Malgré ces défis, il est indéniable que JEPA ouvre la voie à une forme d’apprentissage plus autonome et généralisable, qui peut potentiellement répondre aux besoins des systèmes AGI.

Conclusion : JEPA, Une Voie Prometteuse vers l’AGI ?

En proposant une architecture d’apprentissage autonome, JEPA représente un pas vers la construction de systèmes intelligents capables de comprendre et d’inférer sans supervision humaine. L’approche de Yann LeCun s’aligne sur la quête d’une AGI plus adaptable et capable d’évoluer dans des contextes variés, mais il serait prématuré de la considérer comme une solution complète pour l’AGI.

Pour autant, JEPA pourrait bien constituer une brique fondamentale dans le développement de systèmes d’AGI, en permettant d’apprendre des représentations abstraites et contextuelles qui ne nécessitent pas de supervision explicite. Si la recherche sur JEPA et ses applications concrètes continue de progresser, il est possible que cette architecture soit intégrée dans des modèles futurs, où elle pourrait interagir avec d’autres approches pour construire une AGI plus robuste et versatile.

En fin de compte, JEPA ne prétend pas être l’ultime réponse à l’AGI, mais plutôt une contribution significative dans un domaine en pleine expansion. L’approche de LeCun montre qu’il est possible de réimaginer les fondements de l’apprentissage autonome et de dépasser les limites des méthodes traditionnelles de l’IA, rapprochant un peu plus la science des ambitions de l’AGI.

Source : https://www.youtube.com/watch?v=eDY9FUT5ces